Kann man das Gendern automatisieren?

Überall Gendersternchen verstreuen und fertig? Von wegen. Geschlechtergerecht zu texten, das braucht vor allem Kreativität.

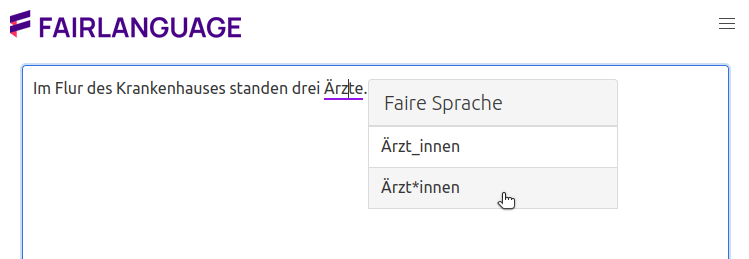

Im Internet gibt es zahlreiche Wörterbücher und Tools, die man benutzen kann, um Wörter in einem Text durch geschlechterneutrale Alternativen zu ersetzen: Ärzte durch Ärzt*innen, Studenten durch Studierende und so weiter. Ein Beispiel ist diese App von Fairlanguage.

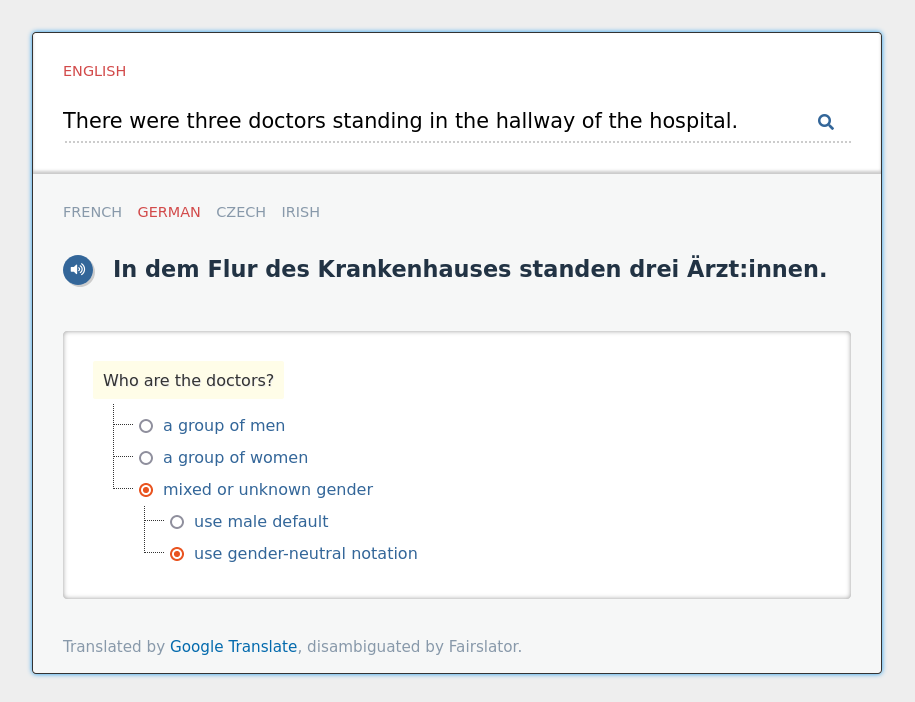

Auch meine eigene App, Fairslator, bieten bei Übersetzungen von Englisch nach Deutsch eine solche Möglichkeit.

Ist damit die Herausforderung der gendergerechten Sprache erledigt? Überall Gendersternchen automatisiert verstreuen und fertig? Von wegen!

Das Problem mit dem Genderstern, mit dem Genderdoppelpunkt und mit anderen solchen Zeichen ist, dass sie den Text weniger lesbar machen. Sie waren alle ursprünglich typografische Zeichen, normalerweise nicht im Wortinneren zu finden. Andere geschlechterneutrale Neuerfindungen wie Partizipien (Studierende, Teilnehmende) haben teilweise den gleichen Effekt, weil sie ja Neuerfindungen sind: beim Lesen muss man oft erstmal kurz nachdenken, bevor man kapiert, was gemeint ist.

Nicht von ungefähr empfiehlt die Autorin Christine Olderdissen in ihrem Buch Genderleicht nicht mehr als ein Genderstern pro Absatz. Sonst wird der Text schwer zu lesen, die Botschaft wird unklar, der Lesegenuss verschwindet.

Also gut, nicht mehr als ein Genderstern pro Absatz. Und der Rest des Texts? Da muss man sich etwas anderes einfallen lassen. Umdenken. Umformulieren. Zum Beispiel, eine beliebte Strategie ist es, auf Substantive in Bezug zu Menschen ganz zu verzichten und Leute direkt in der zweiten Person anzusprechen: statt Ich lade alle Teilenehmer*innen ein sagen wir lieber Ich lade Sie ein! Ist auch wirksamer so. Clever zu texten, das bedeutet Wege in die Herzen der Leser und Leserinnen zu finden. Das ist bestimmt nichts Neues für Werbetexter und Journalisten und so, also für die, die sich mit Texten beruflich beschäftigen. Gender ist dabei nur eine Dimension von vielen.

Hier lohnt es sich einen Schritt zurück zu nehmen und kurz zu überlegen, warum es eigentlich wünschenswert ist, gendergerecht zu schreiben. Gendergerecht zu schreiben, das bedeutet so zu schreiben, dass man alle Menschen anspricht, die man auch ansprechen möchte. Es bedeutet so zu schreiben, dass man keinem Mensch einen Grund gibt, sich ausgeschlossen zu fühlen.

Dieses Ziel erreicht man nicht, wenn man erstmal einen gender-ungerechten Text schreibt und dann alle problematische Wörter automatisch ersetzen lässt. Damit wird ein Problem gelöst und ein anderes verursacht. Der Text ist jetzt gendergerecht (irgendwie), aber umständlich und schwer zu lesen. Wen spricht das an?

Das Genderstern ist etwas, was man automatisieren kann. Man kann Apps wie Fairlanguage und Fairslator entwickeln, die Wörter durch andere Wörter ersetzen, ohne den Text verstehen zu müssen. Aber das Genderstern sollte immer nur das Mittel der letzten Wahl sein. Das Genderstern sollte immer nur dann zum Einsatz kommen, wenn dem Mensch beim Schreiben nichts Besseres einfällt. Texte werden eigentlich von Menschen geschrieben, und der Mensch selbst muss entscheiden, wie die Leser und Leserinnen am besten anzusprechen sind. Fürs Gendern – wie für jedes gute Texten – braucht’s menschliche Kreativität. Das kann man nicht automatisieren.

Nachwort

Eigentlich wollte ich diesen Artikel als eine Art Entschuldigung schreiben. Eine Entschuldigung dafür, wie robotisch und einfallsarm meine App Fairslator beim Übersetzen den Genderdoppelpunkt einsetzt. Fairslator ist ja nur eine Maschine. Sie als Menschen können sich bestimmt etwas Besseres einfallen lassen!

Hinweis

Es gibt keine Verbindung zwischen Fairlanguage und Fairslator. Die Ähnlichkeit der Namen ist reiner Zufall.

Michal Měchura

Michal Měchura